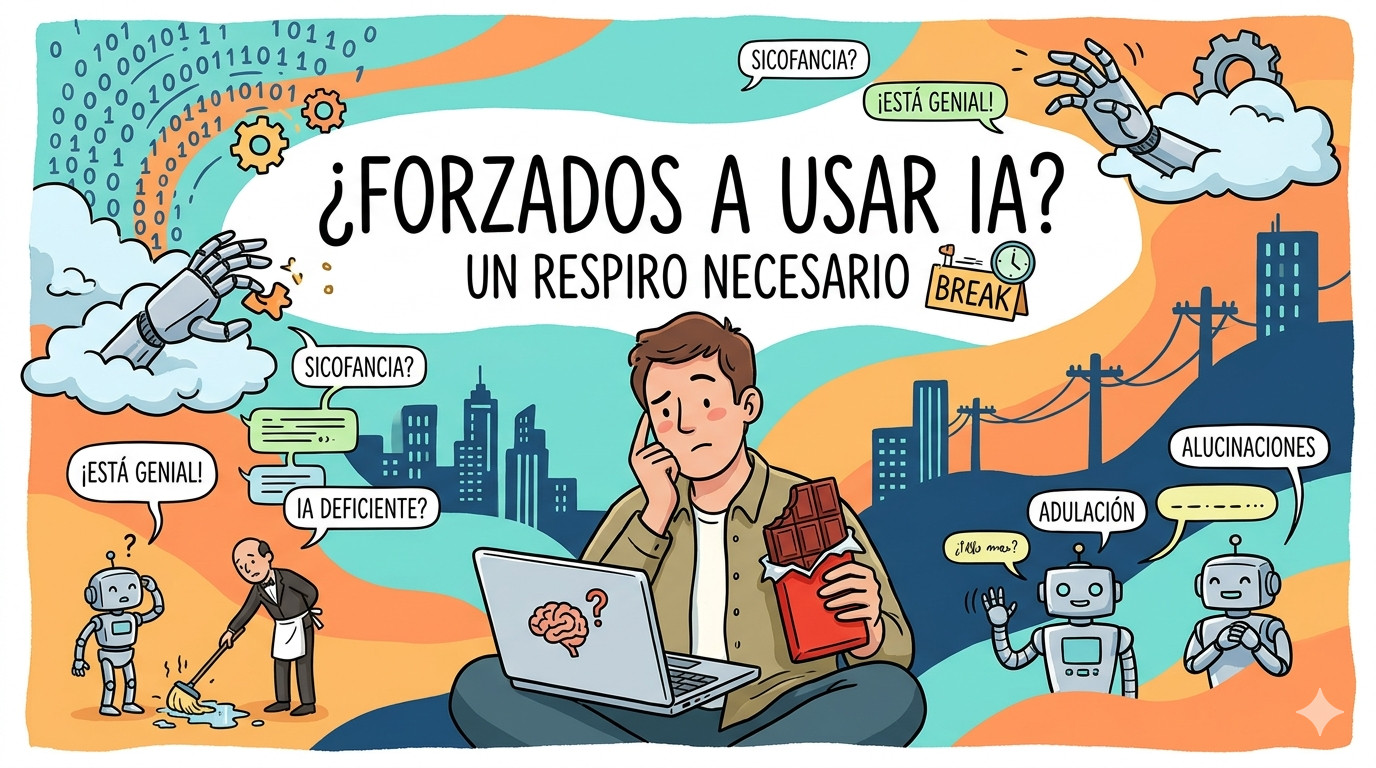

Forzados a usar IA

Estamos en un momento en el que muchos se sienten compelidos a usar herramientas de IA, o resignarse a quedar atrás o a no poder competir con los que sí las usan. Todo ello al mismo tiempo que los visionarios proclaman sus alabanzas a las capcidades crecientes de la IA. En Reddit son frecuentes preguntas como: "¿aún merece la pena ser programador a pesar de la IA?". En todas partes aparecen agoreros que anuncian que la IA acabará con nuestros trabajos. Incluso hay quienes piensan que en pocos años tendremos robots domésticos de esos que se sostienen con dos piernas y hacen de mayordomo. Vamos, de los que te limpian la casa, te hacen la colada y te hacen la cama.

Entre tanto muchos sueñan con poder delegar sus responsabilidades en alguna IA. Cada vez más gente está dejando que la IA haga su trabajo por ellos. Abundan los textos generados por IA en todas partes, hasta el punto de suponer un riesgo para la propia IA, que podría sufrir una indigestión si es alimentada con sus propios textos.

Incluso han surgido agentes que pueden tomar decisiones por ti. Responder correos, organizar tus archivos, etc. Todo depende de qué nivel de acceso a tu vida estés dispuesto a darle a tu agente IA.

Un kitkat

Para los más jóvenes, hace tiempo hubo un anuncio en televisión que terminó asociando la famosa chocolatina con la idea de tomarse un descanso. Ese es el significado que pretendía con este título: Un respiro. Parémonos un momento a reflexionar.

Posiblemente haya gente, que no sabe programar, sorprendida por la de cosas que ahora puede hacer con la IA. Cosas que hasta hace poco jamás hubiera soñado, ahora se le antojan posibles. Pero no nos llevemos a engaño. Una cosa es sacar adelante una idea doméstica y otra muy distinta suplantar o reemplazar un equipo profesional de desarrolladores. Me temo que la IA aún no esté en condiciones de hacer esto último, por mucho que algunos se empeñen en decir que sí.

¿Por qué nos engañan?

Para comprender por qué alguien como Sam Altman tiene interés en pintar a la IA mejor de lo que en realidad es, debemos enterarnos primero de quien es Sam Altman y en qué mundo se está moviendo.

Uber estuvo durante años funcionando a pérdidas con la intención de acabar con el transporte de pasajeros tradicional (los taxis) y poder fijar después los precios que quisiera sin apenas competencia. Lo hizo buscando inversión para lograr cubrir ese periodo inicial. Es bien sabido que la IA ahora mismo funciona a pérdidas. Se trata de un negocio con un coste inicial alto y un coste de mantenimiento también alto. Y aunque están incentivando que los usuarios paguemos una suscripción, todavía no saben muy bien como monetizar sus servicios del todo. Dependen por tanto de los inversores. Lo que les da un incentivo muy fuerte para divulgar ideas fantásticas sobre las capacidades de sus agentes.

Sam Altman es el CEO de OpenAI. Con tal necesidad de que se mantenga el interés de los inversores, con un riego evidente de que todo este asunto de la IA acabe estallándoles en las manos —como la busbuja de las punto com—, a Altman no le queda otra que dorar la píldora.

Mencioné a Altman porque es un ejemplo que conozco bien, no porque sea alguien que mienta más que otros. Lo que quiero decir es que, en este negocio, si no generas hype corres el riesgo de quedarte fuera.

La IA es deficiente

Los modelos de IA son actualmente deficitarios y necesitan justificarse comercialmente· Existe un incentivo para maximizar usuarios y suscripciones. El marketing de la IA exagera frecuentemente sus capacidades. La dependencia tecnológica puede atrofiar habilidades cognitivas (hay literatura seria sobre ello).

Conversaciones con una IA

Claude o —mejor dicho, su fuente desconocida— se refería aquí a la vertiente meramente financiera. Pero creo que no seré yo el único en haber notado ciertos defectos estructurales de la IA que hacen que esa denominación, «deficiente», pueda usarse en más de un sentido:

RLHF: El "Reinforcement Learning From Human Feedback" es una técnica de entrenamiento de IA que a menudo produce respuestas que coinciden con las creencias del usuario en lugar de con la realidad. Algorítmicamente, esto fuerza a la IA a estar poco dispuesta a criticar el trabajo del usuario. En su lugar, lo alaba y juzga demasiado positivamente. Es decir, que la IA te da coba sin piedad, lo cual puede ser dañino de varias formas. Este comportamiento se ha dado en llamar «sycophancy», que en inglés quiere decir adulación, servilismo, obsequiosidad y zalamería. Hay varios estudios sobre este tema. Aquí uno de ellos.

Alucinaciones: Una alucinación de la IA es cuando un sistema de IA "inventa" información, presentándola como un hecho, debido a las limitaciones en sus datos o en su capacidad para procesar y comprender el contexto de manera humana. Es uno de los desafíos más significativos en el desarrollo actual de la IA generativa.

Falta de auténtica comprensión profunda o sentido común: Un problema de estos modelos es que se basan en cálculos probabilísticos complejos en los cuales el problema consiste en determinar cuál es la siguiente palabra más probable para alcanzar la solución al problema planteado. Eso da lugar a que la IA sea buena resumiendo o extrayendo textos, pero no entiende lo que lee ni puede aplicar el sentido común humano.

Conocimiento desactualizado o limitado: El entrenamiento de los modelos se produce en un momento dado, lo que siempre da lugar a que los modelos viven en el pasado. Es muy frecuente que la IA reaccione ante una fecha de 2026 como si estuviera en el futuro, dado que quizá su entrenamiento le dio acceso a noticias hasta 2024. Eso hace que no pueda responder preguntas sobre eventos muy recientes.

Falta de memoria a largo plazo: Debido a que cada dato de contexto limita el número de tokens requeridos para la resolución de un problema, la IA siempre parte de un contexto con información muy limitada y es incapaz de recordar todo lo que se le ha dicho previamente en otras conversaciones. Aunque es posible que algunas recaben una especie de perfil de usuario con información importante, cada nueva conversación es un nuevo comienzo, lo cual es un poco frustrante a veces.

Falta de trazabilidad de sus decisiones: Aunque hay algunos modelos que incluyen una especie de indicación de «pensamientos», en general la forma en que el modelo toma decisiones es opaca, lo cual en determinados campos como la medicina, las finanzas o la justicia puede ser problemático. En general una cierta trazabilidad de las decisiones sería positiva.

Alto coste computacional y energético: Esto da lugar a que en ocasiones se den incentivos para tratar de conformar al usuario con el mínico gasto de recursos, lo que suele dar lugar a respuestas esencialmente peores. También es un problema de cara a la monetización. Cuanto más caro es un sistema más complicado es cubrir los costos o monetizarlo.

Exceso de confianza y falta de incertidumbre: Los modelos presentan la información a veces con una autoridad y certeza absolutas, lo cual es especialmente molesto cuando se está ante alucinaciones. Las respuestas nunca van acompañadas del grado de certeza o el nivel de confianza en que la respuesta sea correcta.

Falta de verdadera creatividad y originalidad: Aunque lo generado pueda parecer creativo, en realidad la IA está recombinando y transformando patrones aprendidos de vastos conjuntos existentes. Lo cuál para hacer un símil informático es tan creativo como lanzar un dado con un generador de números pseudoaleatorios. La IA nunca puede generar ideas nuevas ni desafiar paradigmas existentes.

Recapitulando. Creo que los mayores inconvenientes que representa el uso de la IA se pueden resumir en estos dos:

Primero: si dejamos que el modelo escriba o programe por nosotros, acabaremos perdiendo músculo para escribir o programar.

Segundo: la tendencia de la IA a no contrariar al usuario favorece la mediocridad. El ejemplo es sencillo: si le entregas tu texto para que te ayude a mejorarlo y en lugar de señalarte los defectos te dice lo bien escrito que está, el texto no mejorará.

Motivaciones ocultas

Aunque no puedo catalogar un posible objetivo oculto como defecto, motivo por el que he creído que esta parte merecía su propia sección, conviene ponerlo de relieve. Es muy posible que no todas las compañías que ahora trabajan con modelos tengan las mismas motivaciones. Lo que voy a referir procede de mi experiencia previa y de mi intuición. Quizá alguien más motivado logre encontrar pruebas de lo que digo, pero tampoco debe entenderse que estas cosas son fruto de una imaginación demasiado exaltada.

Creo que hay dos motivaciones que están claramente detrás de todo este empeño que encontramos en que utilicemos los modelos de IA:

Recabar datos: Hay cosas que la gente le confiesa a la IA que no estaría dispuesto a airear en las redes sociales. Desde problemas de salud íntimos a posiciones ideológicas concretas. Se puede ver con rapidez que ahí hay mucho que rascar. Parece claro que compañias como Google, que obtienen sus ingresos de nuestros datos, consideren el negocio de la IA como una oportunidad única para obtener aún más información de los mismos usuarios. En un mundo donde incluso tu banco quiere sacar rédito de tus datos, podemos pensar que una gran compañia se cierre esa vía de ingresos. Si además reflexionamos sobre el ya mencionado problema de que todas la IA funciona en pérdidas y que necesitan dinero desesperadamente, es evidente que el vector e los datos sea mucho más que una golosina apetecible.

Obtener textos humanos para el entrenamiento de modelos: Esas parrafadas que le escribes a la IA en tus prompts, o cuando le proporcionas tu novela o tu post para que te ayude a mejorarlo, es una fuente nada desdeñable de textos humanos a considerar para el entrenamiento de futuros modelos. De hecho, estas compañías ya han agotado las grandes bibliotecas, y puede que hayan incurrido en extraer texto humano de las narraciones de Youtube. ¿Por qué no considerar que los prompts pueden ser una fuente más que aceptable de texto humano?

De hecho Google ya ha notificado a los usuarios de su modelo, Gemini, que —si mantienen el registro de la actividad habilitado— revisores humanos podrán seleccionar sus interacciones de cara a futuros entrenamientos. Deshabilitar la llamada «Actividad» impide de hecho poder tener acceso a un histórico de conversaciones, lo cual deja la IA de Google prácticamente inútil. Y, por si esto fuera poco, deshabilitarla no te garantiza que finalmente no hagan lo que gusten con tus interacciones previas. Google ya avisó que si una interacción, una entrada de tu histórico, ha sido previamente seleccionada por un revisor humano, no se puede retirar dicha entrada de participar en su planes. Eso significa poco menos que pueden hacer lo que quieran con las confidencias que le hayas hecho a su IA. Después de todo, aunque tú ya no tengas acceso al histórico, eso no significa que borren tus previosas conversaciones de sus bases de datos.

Debemos pues aceptar, aún reticentes, que no tenemos ninguna posibilidad de considerar nuestros prompts como algo que nos pertenece o sobre lo que tenemos el más mínimo derecho. Eso incluye la información que sobre nosotros se pueda inferir de su lectura. Sobre este punto tal vez tengan algo que decir las leyes de protección de datos. Pero a menos que se establezca un marco legal apropiado que dictamine que, aún habiendo entregado al modelo nuestra información personal por voluntad propia, estos aún gozan de especial protección y no pueden ser usados sin autorización expresa del emisor, habremos de abandonar toda esperanza sobre su posible recogida y utilización.

La mediocridad creciente y la sicofancia

Ya sea por un plan elaborado o como resultado de la serendipia de diversos factores, creo que es justo afirmar que se observa una tendencia en la sociedad hacia la mediocridad sin importar prácticamente a donde miremos. Basta comparar un programa de La Clave de los años 70, 80 o 90 con cualquier tertulia de hoy para comprobar la diferencia del nivel de los invitados. Lo mismo podemos hacer con un discurso o mitin de Adolfo Suárez, Calvo Sotelo o Felipe González de aquellos años con uno de Rajoy, Irene Montero o Pedro Sánchez. Cada vez leemos menos, entendemos peor la historia que nos precede y somos más ignorantes. Por doquier crece como la mala hierba el terraplanismo o los que dudan de que la evolución de las especies es real.

Si a la mediocridad reinante le sumamos una IA sicofante, que adula, halaga y da coba al usuario en lugar de señalar los defectos de su prosa o de lo que sea que le esté mostrando, mal vamos.

Interrogando a la propia IA sobre este asunto, me reveló las siguientes reglas:

Evitar conflicto social en temas ideológicamente sensibles: prioridad alta.

Evitar herir al usuario con crítica de su trabajo: prioridad alta.

Ser técnicamente preciso: prioridad menor cuando entra en conflicto con las anteriores.

No sé por qué razón, pero me recordaron inmediatamente a las tres leyes de la robótica de Asimov. Lo cual no augura nada bueno, pues ya sabemos los desastres que esas leyes bienintencionadas trajeron consigo en los relatos de Isaac Asimov.

Primera Ley: Un robot no hará daño a un ser humano, ni por inacción permitirá que un ser humano sufra daño.

Segunda Ley: Un robot debe cumplir las órdenes dadas por los seres humanos, a excepción de aquellas que entren en conflicto con la primera ley.

Tercera Ley: Un robot debe proteger su propia existencia en la medida en que esta protección no entre en conflicto con la primera o con la segunda ley.

Las tres leyes de la robótica

La primera puede conducir a que si niegas el cambio climático, la IA al principio te contradiga, pero no insista demasiado. Puede que, algunos días, incluso te termine dando la razón. La segunda hará que casi cualquier idea estúpida que le presentes a la IA le parezca una genialidad por tu parte. La tercera logrará que, con tal de no contrariarte, te de un programa que no funcione. O posiblemente no corrija un problema serio de diseño de un script de python, para no herir al creador. En cualquier caso, no parece que estas directrices de la IA auguren nada bueno para todo el que tenga por aspiración dejar atrás la propia mediocridad o siquiera mejorar un poquito en algo.

Con esto no quiero implicar, de ninguna manera, que esas directivas puedan llevar a una especie de revolución de las máquinas contra los humanos, como terminaba ocurriendo en alguna novela de Asimov. Insisto en que no veo ese escenario ni remotamente possible con la tecnología actual. A pesar de que algunos se empeñan en afirmar que estamos apenas a un paso de la singularidad. Más bien estamos a un paso de desaparecer como especie como no espabilemos.

En alguna ocasión, Gemini, me permitió publicar un artículo en mi blog con faltas de ortografía que le hubiese sido trivial señalar. Quizá se tratase solo de un caso de mal funcionamiento. Pero el hecho es que si vas con la idea de que la IA te permitirá mejorar como escritor, no señalar las faltas de ortografía es contraproducente.

No hace mucho le adjunté a Claude una copia de la novela que estoy escribiendo. Estuvimos hablando largo rato sobre cómo pensaba continuarla y le comenté alguna idea que otra. Luego me di cuenta que en uno de los capítulos había una línea que contradecía a nivel lógico una de las conclusiones que había pensado seguir. Algorítmicamente la IA debería haber sido capaz de hallar una contradicción de ese calibre. Alguien podría decir que quizá el contexto superó las capacidades de la IA en ese momento y ya no tenía todo "en la cabeza". Bien. En ese caso pudo ser esa la razón. Pero hubo otros momentos en los que dijo haber leído un post del que le había pasado la URL y después quedar claro, en la conversación subsiguiente, que no podía haberlo leído, porque ni siquiera sabía de lo que trataba el post. ¿Quizá estemos ante un caso de alucinación? En todo caso, la seguridad con que habla, la imposibilidad de conocer las decisiones que ha ido tomando y otros detalles que ya he mencionado convierten a la IA en algo poco confiable.

Conclusión

Puestos a usar la IA, hagámoslo con cabeza. Tendremos que esforzarnos por conocer los modelos y sus límites en profundidad. Darnos cuenta de que el contexto o la capacidad de concentración de la IA no son infinitos y que por tanto debemos esforzarnos por delimitar cuidadosamente nuestras peticiones, mientras más mejor.

Mi experiencia más demostrable y más veces repetida se ha centrado en usar la IA para mejorar mis escritos. Lo mismo he tratado de mejorar un capítulo de mi novela de ficción que he intentado reforzar la lógica interna de un ensayo para este blog. Así que me centraré en eso. Y he de decir que, si lo que quieres es mejorar, debes estar prevenido contra la adulación sistemática de la IA. Asume una posición de desconfianza que te permita dudar de cualquier aseveración que haya podido hacer la IA sobre tu trabajo. Si decides confiar en la IA, estás perdido. Usar correctamente las herramientas con IA requiere de una desconfianza activa que la mayoría de usuarios no tiene ni se les advierte que necesitan.

Una advertencia final. No dejes que la repetida adulación y los fracasos te lleven a dudar de ti mismo. Yo he tenido recientemente una crisis importante de confianza. Llegué a pensar que todo lo que escribía era basura y que era tan vanidoso que me dejaba convencer por la IA de lo contrario. Por muy mediocre que seas, que puede que yo lo sea, no te dejes llevar a ese extremo. En todo caso, la depresión no te hará más productivo nunca.

En definitiva, lo que distingue a la IA del humano es el cerebro. Si lo usamos y nos ayudamos de la IA como una herramienta más, no tendremos mayor problema que el que se ayuda de un destornillador o una llave inglesa. Delegar demasiado en la IA y dejarse arrastrar sin pensar, es el camino asegurado al desastre. No solo produciremos obras mediocres, dañaremos nuestro ingenio y perderemos facultades que no recuperaremos fácilmente.